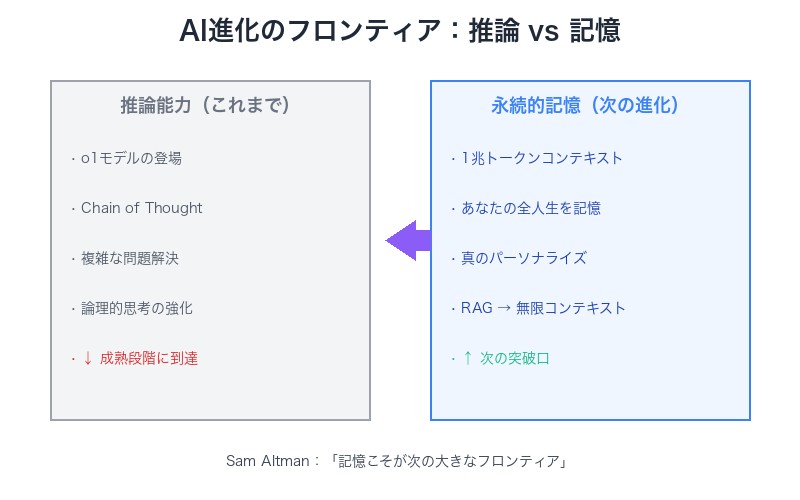

「推論能力の向上」ではなく「永続的な記憶」

「AIの本当のブレークスルーは推論能力の向上ではなく、完全で永続的な記憶だ」

OpenAI CEO サム・アルトマン氏がSequoia主催のAIイベントで語ったこの言葉が、AI業界に大きな反響を呼んでいます。o3やGemini 3など推論能力の競争が過熱する中、アルトマン氏は「次の勝負」はそこではないと明言しました。

AI研修で年間350社を支援するデジライズCEOのチャエン氏もこの見解に同意し、「これは間違いない。o3くらいから推論は十分で、あとは『こちらが適切で十分な情報を渡せるか』だと感じていた」とコメントしています。

私たちが日々AIを使う中で感じる「なぜ分かってくれないのか」という不満。その多くは、AIの推論能力の問題ではなく、AIが私たちのことを覚えていないことに起因しているのです。

「1兆トークンに人生すべてを入れる」ビジョン

アルトマン氏が描く理想像は、想像を超えるものでした。

「理想は、非常に小さな推論モデルと1兆トークンのコンテキスト。そこに人生すべてを入れる」

具体的には以下のようなデータがすべてAIの記憶に入ります。

- これまでに交わしたすべての会話

- 読んだすべての本

- やり取りしたすべてのメール

- 見たすべてのウェブページ、ドキュメント

- 他のサービスから連携されるデータ

「そして、あなたの人生が常にコンテキストに追記され続ける」とアルトマン氏は語ります。

この発言は、アルトマン氏が「メモリは2025年のお気に入り機能」と述べ、GPT-6をユーザーの好みやルーティンに適応するAIとして構想していることとも符合します。

| 現在のAI | アルトマン氏のビジョン |

|---|---|

| 会話ごとにリセット | 生涯を通じて記憶を蓄積 |

| 限られたコンテキスト | 1兆トークンのコンテキスト |

| 毎回説明が必要 | あなたを完全に理解 |

| 汎用的な応答 | 究極のパーソナライズ |

解決策は大きく2つ

「永続的な記憶」を実現するアプローチは、大きく2つに分かれます。チャエン氏の分析によれば:

アプローチ1:RAG的な外部連携

他のアプリケーションと連携し、必要に応じて情報を取りに行く方式です。

- Slack連携:過去のやり取りを参照

- メール連携:メールの内容を理解

- Google Drive連携:ドキュメントを読み取り

- カレンダー連携:スケジュールを把握

ChatGPTは既にSlack、メール、ドライブなどとの接続機能を提供し始めており、チャエン氏は「前者(RAG連携)は来年〜再来年には精度がかなり上がりそう」と予測しています。

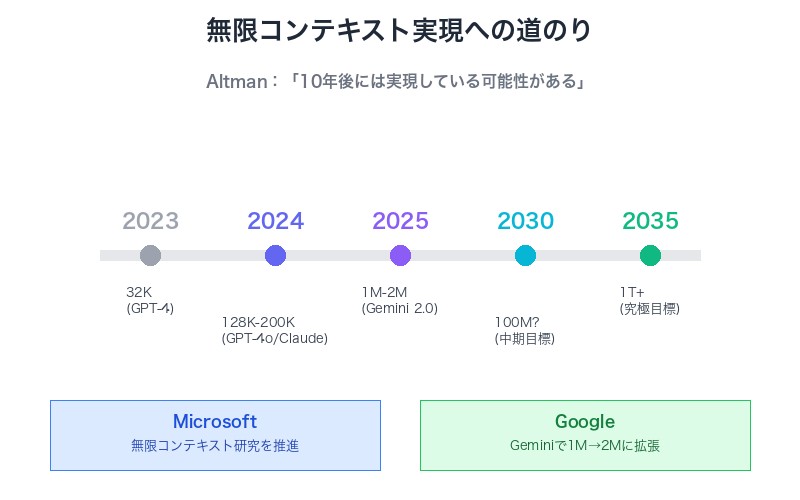

アプローチ2:コンテキストウィンドウの無限化

すべての情報をコンテキストに入れ、AIが一度に読み取る方式です。

こちらは技術的にははるかに難しく、アルトマン氏は「10年以内に実現」と述べています。現時点では、以下のような状況です。

| モデル | コンテキストウィンドウ | 備考 |

|---|---|---|

| GPT-4o | 128Kトークン | 約10万語 |

| Claude 3.5 | 200Kトークン | 約15万語 |

| Gemini 1.5 Pro | 1Mトークン | 約75万語(リード) |

| 理想(アルトマン構想) | 1Tトークン | Geminiの1000倍 |

現時点ではGoogleが1Mトークンで「ややリード」している状況です。しかしアルトマン氏が語る「1兆トークン」は、Googleの現在の1000倍。この差を埋めるには、根本的な技術革新が必要です。

なぜ「推論」より「記憶」なのか

アルトマン氏が推論より記憶を重視する理由は明確です。

「推論能力は、日常的な使用においては既に収穫逓減のポイントに達している。今日のシステムを制限しているのは、サービスを提供する人々について継続的な理解を構築できないことだ」

つまり、AIの「頭の良さ」は既に十分。問題は「どれだけあなたのことを知っているか」なのです。

具体例で考える

あなたが毎週月曜日に週次レポートを作成するとします。

- 現在のAI:毎回「先週の売上データは〇〇で、目標は△△で…」と説明が必要

- 記憶を持つAI:「いつもの週次レポートですね。先週より5%改善していますね」と自動で把握

この差は、推論能力の問題ではありません。コンテキスト(文脈)の問題です。

OpenAIとMicrosoftの動き

OpenAIとMicrosoftは、この「無限メモリ」の実現に向けて共同で取り組んでいることを発表しています。

両社の協業は以下を目指しています:

- ほぼ無限のメモリ容量を持つAIモデルの開発

- 大幅に拡張されたコンテキストウィンドウ

- AIが情報を処理・相互作用する方法の変革

アルトマン氏は、より高度なメモリ駆動型パーソナルアシスタントが2026年には登場し始める可能性があると示唆しています。

Google vs OpenAI:コンテキスト競争

コンテキストウィンドウの競争では、現時点でGoogleがリードしています。

| 企業 | 現在のリーダーモデル | コンテキスト | 今後の方向性 |

|---|---|---|---|

| Gemini 1.5 Pro | 1Mトークン | さらなる拡張を継続 | |

| OpenAI | GPT-4o | 128Kトークン | 10年で無限化を目指す |

| Anthropic | Claude 3.5 | 200Kトークン | 品質重視のアプローチ |

しかし、単純なトークン数だけでは測れない要素もあります。どれだけ長いコンテキストを正確に処理できるか、検索と組み合わせてどれだけ効率的に情報を取り出せるか—こうした「質」の競争も同時に進んでいます。

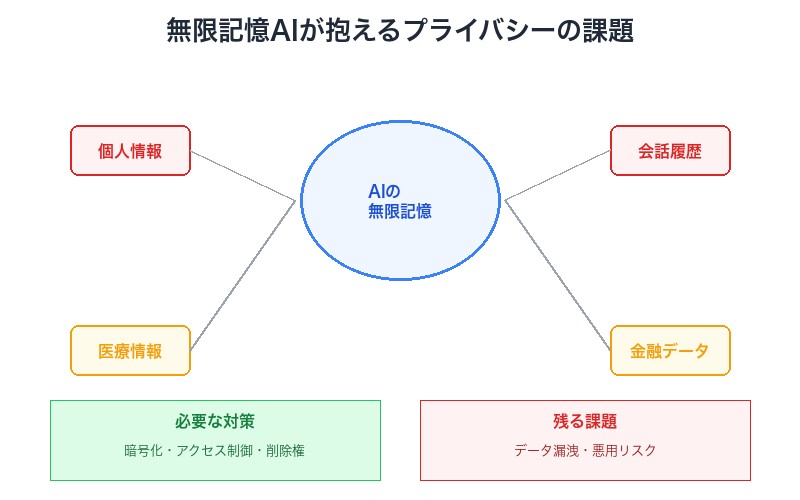

プライバシーの懸念

「人生すべてをAIに入れる」というビジョンには、当然ながらプライバシーの懸念が伴います。

アルトマン氏自身もこれを認識しており、「これは社会がプライバシーが本当に重要だと認識する瞬間になることを願っている」と述べています。

現在、米国、EU、その他の国々では、AIの透明性、データ保持、ユーザー権利に関する新しい規制が活発に議論されています。「永続的な記憶」を持つAIの登場は、この議論をさらに加速させることになるでしょう。

考慮すべきポイント

- データの所有権:誰がその記憶を所有するのか

- 削除の権利:ユーザーは記憶を削除できるのか

- アクセス制御:誰がその記憶にアクセスできるのか

- セキュリティ:人生すべてのデータが漏洩したら?

実現へのタイムライン

チャエン氏の分析と各種報道を総合すると、以下のようなタイムラインが見えてきます。

| 時期 | 予想される進展 |

|---|---|

| 2025年 | Slack/メール/ドライブ連携の本格普及 |

| 2026年 | メモリ駆動型パーソナルアシスタント登場 |

| 2026-2027年 | RAG連携の精度大幅向上 |

| 2030年代前半 | コンテキストウィンドウの大幅拡張 |

| 2035年頃 | 「無限コンテキスト」の実現(アルトマン予測) |

短期的にはRAG連携が進み、長期的にはコンテキストの無限化が実現する—この2本立てで「永続的な記憶」への道が開かれていくと考えられます。

今、私たちにできること

「永続的な記憶」を持つAIが登場するまでの間、私たちにできることがあります。

- AIに渡す情報を整理する:適切で十分な情報を渡すことが、現時点での最適解

- 連携機能を活用する:ChatGPTのSlack/メール連携などを積極的に使う

- プロンプトテンプレートを作る:毎回同じ説明をする代わりに、テンプレート化

- メモリ機能を活用する:ChatGPTのメモリ機能を意識的にオンにする

「推論は十分。あとは情報の渡し方」—この認識を持つだけで、AIの活用効率は大きく変わります。

まとめ:推論の時代から記憶の時代へ

サム・アルトマン氏が示したAIの次のフロンティアは、明確です。

- 推論能力は既に十分:o3レベルで日常使用には十分な水準

- 次のブレークスルーは記憶:永続的で完全な記憶がAIを変える

- 理想像:1兆トークンのコンテキストに人生すべてを入れる

- 2つの道:RAG連携(短期)とコンテキスト無限化(長期)

- 実現時期:無限コンテキストは10年以内

「AIがあなたのことを知っている」世界。それは、毎回の説明が不要になり、真にパーソナライズされたアシスタントが実現する世界です。プライバシーとのバランスを取りながら、この未来は着実に近づいています。

関連記事:

コメント